HBase – 安装

HBase – 安装

本章解释了 HBase 是如何安装和初始配置的。继续使用 HBase 需要 Java 和 Hadoop,因此您必须在系统中下载并安装 Java 和 Hadoop。

预安装设置

在将 Hadoop 安装到 Linux 环境之前,我们需要使用ssh(Secure Shell)设置 Linux 。按照下面给出的步骤设置 Linux 环境。

创建用户

首先,建议为Hadoop创建一个单独的用户,将Hadoop文件系统与Unix文件系统隔离开来。按照下面给出的步骤创建用户。

- 使用命令“su”打开根目录。

- 使用命令“useradd username”从 root 帐户创建一个用户。

- 现在您可以使用命令“su username”打开一个现有的用户帐户。

打开 Linux 终端并键入以下命令以创建用户。

$ su password: # useradd hadoop # passwd hadoop New passwd: Retype new passwd

SSH 设置和密钥生成

需要 SSH 设置才能在集群上执行不同的操作,例如启动、停止和分布式守护进程 shell 操作。为了对Hadoop的不同用户进行身份验证,需要为一个Hadoop用户提供公钥/私钥对,并与不同的用户共享。

以下命令用于使用 SSH 生成键值对。将id_rsa.pub中的公钥复制到authorized_keys中,分别为authorized_keys文件提供owner、读写权限。

$ ssh-keygen -t rsa $ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys $ chmod 0600 ~/.ssh/authorized_keys

验证 ssh

ssh localhost

安装 Java

Java 是 Hadoop 和 HBase 的主要先决条件。首先,您应该使用“java -version”验证系统中是否存在java。java version 命令的语法如下。

$ java -version

如果一切正常,它将为您提供以下输出。

java version "1.7.0_71" Java(TM) SE Runtime Environment (build 1.7.0_71-b13) Java HotSpot(TM) Client VM (build 25.0-b02, mixed mode)

如果您的系统中未安装 java,请按照下面给出的步骤安装 java。

第1步

通过访问以下链接Oracle Java下载 java (JDK <最新版本> – X64.tar.gz) 。

然后jdk-7u71-linux-x64.tar.gz将被下载到您的系统中。

第2步

通常,您会在 Downloads 文件夹中找到下载的 java 文件。验证它并使用以下命令提取jdk-7u71-linux-x64.gz文件。

$ cd Downloads/ $ ls jdk-7u71-linux-x64.gz $ tar zxf jdk-7u71-linux-x64.gz $ ls jdk1.7.0_71 jdk-7u71-linux-x64.gz

第 3 步

要使所有用户都可以使用 java,您必须将其移动到“/usr/local/”位置。打开 root 并键入以下命令。

$ su password: # mv jdk1.7.0_71 /usr/local/ # exit

第四步

要设置PATH和JAVA_HOME变量,请将以下命令添加到~/.bashrc文件中。

export JAVA_HOME=/usr/local/jdk1.7.0_71 export PATH= $PATH:$JAVA_HOME/bin

现在将所有更改应用到当前运行的系统中。

$ source ~/.bashrc

第 5 步

使用以下命令配置 java 替代方案:

# alternatives --install /usr/bin/java java usr/local/java/bin/java 2 # alternatives --install /usr/bin/javac javac usr/local/java/bin/javac 2 # alternatives --install /usr/bin/jar jar usr/local/java/bin/jar 2 # alternatives --set java usr/local/java/bin/java # alternatives --set javac usr/local/java/bin/javac # alternatives --set jar usr/local/java/bin/jar

现在从终端验证java -version命令,如上所述。

下载 Hadoop

安装完java后,还得安装Hadoop。首先,使用“Hadoop version”命令验证Hadoop的存在,如下所示。

hadoop version

如果一切正常,它将为您提供以下输出。

Hadoop 2.6.0 Compiled by jenkins on 2014-11-13T21:10Z Compiled with protoc 2.5.0 From source with checksum 18e43357c8f927c0695f1e9522859d6a This command was run using /home/hadoop/hadoop/share/hadoop/common/hadoop-common-2.6.0.jar

如果您的系统无法定位 Hadoop,请在您的系统中下载 Hadoop。按照下面给出的命令执行此操作。

使用以下命令从 Apache Software Foundation下载并提取hadoop-2.6.0。

$ su password: # cd /usr/local # wget http://mirrors.advancedhosters.com/apache/hadoop/common/hadoop- 2.6.0/hadoop-2.6.0-src.tar.gz # tar xzf hadoop-2.6.0-src.tar.gz # mv hadoop-2.6.0/* hadoop/ # exit

安装 Hadoop

以任何所需的模式安装 Hadoop。在这里,我们以伪分布式模式演示 HBase 功能,因此以伪分布式模式安装 Hadoop。

以下步骤用于安装Hadoop 2.4.1。

第 1 步 – 设置 Hadoop

您可以通过将以下命令附加到~/.bashrc文件来设置 Hadoop 环境变量。

export HADOOP_HOME=/usr/local/hadoop export HADOOP_MAPRED_HOME=$HADOOP_HOME export HADOOP_COMMON_HOME=$HADOOP_HOME export HADOOP_HDFS_HOME=$HADOOP_HOME export YARN_HOME=$HADOOP_HOME export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin export HADOOP_INSTALL=$HADOOP_HOME

现在将所有更改应用到当前运行的系统中。

$ source ~/.bashrc

第 2 步 – Hadoop 配置

您可以在“$HADOOP_HOME/etc/hadoop”位置找到所有 Hadoop 配置文件。您需要根据您的 Hadoop 基础架构对这些配置文件进行更改。

$ cd $HADOOP_HOME/etc/hadoop

为了用java开发Hadoop程序,您必须通过将JAVA_HOME值替换为您系统中java的位置来重置hadoop-env.sh文件中的java环境变量。

export JAVA_HOME=/usr/local/jdk1.7.0_71

您必须编辑以下文件才能配置 Hadoop。

核心站点.xml

该芯-的site.xml文件包含的信息,如用于Hadoop的实例的端口号,分配给文件系统,存储器限制用于存储数据的存储器,和读/写缓冲器的大小。

打开 core-site.xml 并在 <configuration> 和 </configuration> 标记之间添加以下属性。

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

hdfs-site.xml

在HDFS-的site.xml文件中包含的信息,如复制数据的价值,名称节点的路径,你的本地文件系统,要存储的Hadoop基础架构的数据节点的路径。

让我们假设以下数据。

dfs.replication (data replication value) = 1 (In the below given path /hadoop/ is the user name. hadoopinfra/hdfs/namenode is the directory created by hdfs file system.) namenode path = //home/hadoop/hadoopinfra/hdfs/namenode (hadoopinfra/hdfs/datanode is the directory created by hdfs file system.) datanode path = //home/hadoop/hadoopinfra/hdfs/datanode

打开此文件并在 <configuration>、</configuration> 标记之间添加以下属性。

<configuration>

<property>

<name>dfs.replication</name >

<value>1</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>file:///home/hadoop/hadoopinfra/hdfs/namenode</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>file:///home/hadoop/hadoopinfra/hdfs/datanode</value>

</property>

</configuration>

注意:在上述文件中,所有属性值都是用户定义的,您可以根据您的 Hadoop 基础架构进行更改。

纱线站点.xml

该文件用于将 yarn 配置到 Hadoop 中。打开 yarn-site.xml 文件并在 <configuration$gt;、</configuration$gt; 之间添加以下属性。此文件中的标签。

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

mapred-site.xml

该文件用于指定我们使用的 MapReduce 框架。默认情况下,Hadoop 包含一个yarn-site.xml 模板。首先,需要使用以下命令将文件从mapred-site.xml.template复制到mapred-site.xml文件。

$ cp mapred-site.xml.template mapred-site.xml

打开mapred-site.xml文件并在 <configuration> 和 </configuration> 标记之间添加以下属性。

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

验证 Hadoop 安装

以下步骤用于验证 Hadoop 安装。

步骤 1 – 名称节点设置

使用命令“hdfs namenode -format”设置namenode,如下所示。

$ cd ~ $ hdfs namenode -format

预期结果如下。

10/24/14 21:30:55 INFO namenode.NameNode: STARTUP_MSG: /************************************************************ STARTUP_MSG: Starting NameNode STARTUP_MSG: host = localhost/192.168.1.11 STARTUP_MSG: args = [-format] STARTUP_MSG: version = 2.4.1 ... ... 10/24/14 21:30:56 INFO common.Storage: Storage directory /home/hadoop/hadoopinfra/hdfs/namenode has been successfully formatted. 10/24/14 21:30:56 INFO namenode.NNStorageRetentionManager: Going to retain 1 images with txid >= 0 10/24/14 21:30:56 INFO util.ExitUtil: Exiting with status 0 10/24/14 21:30:56 INFO namenode.NameNode: SHUTDOWN_MSG: /************************************************************ SHUTDOWN_MSG: Shutting down NameNode at localhost/192.168.1.11 ************************************************************/

第 2 步 – 验证 Hadoop dfs

以下命令用于启动dfs。执行此命令将启动您的 Hadoop 文件系统。

$ start-dfs.sh

预期输出如下。

10/24/14 21:37:56 Starting namenodes on [localhost] localhost: starting namenode, logging to /home/hadoop/hadoop- 2.4.1/logs/hadoop-hadoop-namenode-localhost.out localhost: starting datanode, logging to /home/hadoop/hadoop- 2.4.1/logs/hadoop-hadoop-datanode-localhost.out Starting secondary namenodes [0.0.0.0]

第 3 步 – 验证纱线脚本

以下命令用于启动纱线脚本。执行此命令将启动您的纱线守护进程。

$ start-yarn.sh

预期输出如下。

starting yarn daemons starting resourcemanager, logging to /home/hadoop/hadoop- 2.4.1/logs/yarn-hadoop-resourcemanager-localhost.out localhost: starting nodemanager, logging to /home/hadoop/hadoop- 2.4.1/logs/yarn-hadoop-nodemanager-localhost.out

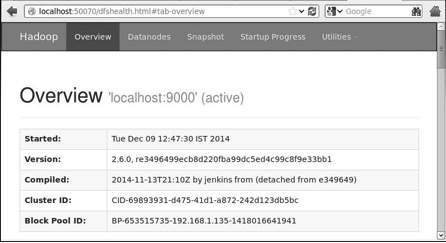

第 4 步 – 在浏览器上访问 Hadoop

访问 Hadoop 的默认端口号是 50070。使用以下 URL 在浏览器上获取 Hadoop 服务。

http://localhost:50070

第 5 步 – 验证集群的所有应用程序

访问集群所有应用的默认端口号是8088。使用下面的url访问这个服务。

http://localhost:8088/

安装 HBase

我们可以在三种模式中的任何一种安装HBase:Standalone模式、Pseudo Distributed模式和Fully Distributed模式。

以单机模式安装 HBase

使用“wget”命令从http://www.interior-dsgn.com/apache/hbase/stable/下载最新的HBase稳定版本,并使用tar“zxvf”命令解压。请参阅以下命令。

$cd usr/local/ $wget http://www.interior-dsgn.com/apache/hbase/stable/hbase-0.98.8- hadoop2-bin.tar.gz $tar -zxvf hbase-0.98.8-hadoop2-bin.tar.gz

切换到超级用户模式并将 HBase 文件夹移动到 /usr/local ,如下所示。

$su $password: enter your password here mv hbase-0.99.1/* Hbase/

在独立模式下配置 HBase

在继续使用 HBase 之前,您必须编辑以下文件并配置 HBase。

hbase-env.sh

为 HBase 设置 java Home 并从 conf 文件夹中打开hbase-env.sh文件。编辑 JAVA_HOME 环境变量并将现有路径更改为当前 JAVA_HOME 变量,如下所示。

cd /usr/local/Hbase/conf gedit hbase-env.sh

这将打开 HBase 的 env.sh 文件。现在用您当前的值替换现有的JAVA_HOME值,如下所示。

export JAVA_HOME=/usr/lib/jvm/java-1.7.0

hbase-site.xml

这是HBase的主要配置文件。通过打开 /usr/local/HBase 中的 HBase 主文件夹,将数据目录设置到适当的位置。在conf文件夹里面,你会发现几个文件,打开hbase-site.xml文件如下图。

#cd /usr/local/HBase/ #cd conf # gedit hbase-site.xml

在hbase-site.xml文件中,您将找到 <configuration> 和 </configuration> 标记。在其中,将属性键下的 HBase 目录设置为“hbase.rootdir”,如下所示。

<configuration>

//Here you have to set the path where you want HBase to store its files.

<property>

<name>hbase.rootdir</name>

<value>file:/home/hadoop/HBase/HFiles</value>

</property>

//Here you have to set the path where you want HBase to store its built in zookeeper files.

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/home/hadoop/zookeeper</value>

</property>

</configuration>

到此,HBase的安装和配置部分就顺利完成了。我们可以使用 HBase的 bin 文件夹中提供的start-hbase.sh脚本来启动HBase。为此,打开 HBase 主文件夹并运行 HBase 启动脚本,如下所示。

$cd /usr/local/HBase/bin $./start-hbase.sh

如果一切顺利,当您尝试运行 HBase 启动脚本时,它会提示您一条消息说 HBase 已启动。

starting master, logging to /usr/local/HBase/bin/../logs/hbase-tpmaster-localhost.localdomain.out

伪分布式方式安装HBase

现在让我们检查一下 HBase 是如何以伪分布式模式安装的。

配置 HBase

在继续使用 HBase 之前,请在本地系统或远程系统上配置 Hadoop 和 HDFS,并确保它们正在运行。如果 HBase 正在运行,请停止它。

hbase-site.xml

编辑 hbase-site.xml 文件以添加以下属性。

<property> <name>hbase.cluster.distributed</name> <value>true</value> </property>

它将提到应该以哪种模式运行 HBase。在来自本地文件系统的同一个文件中,使用 hdfs://// URI 语法更改 hbase.rootdir,即您的 HDFS 实例地址。我们在本地主机的 8030 端口运行 HDFS。

<property> <name>hbase.rootdir</name> <value>hdfs://localhost:8030/hbase</value> </property>

启动 HBase

配置完成后,浏览到 HBase 主文件夹并使用以下命令启动 HBase。

$cd /usr/local/HBase $bin/start-hbase.sh

注意:在启动 HBase 之前,请确保 Hadoop 正在运行。

检查 HDFS 中的 HBase 目录

HBase 在 HDFS 中创建其目录。要查看创建的目录,请浏览到 Hadoop bin 并键入以下命令。

$ ./bin/hadoop fs -ls /hbase

如果一切顺利,它将为您提供以下输出。

Found 7 items drwxr-xr-x - hbase users 0 2014-06-25 18:58 /hbase/.tmp drwxr-xr-x - hbase users 0 2014-06-25 21:49 /hbase/WALs drwxr-xr-x - hbase users 0 2014-06-25 18:48 /hbase/corrupt drwxr-xr-x - hbase users 0 2014-06-25 18:58 /hbase/data -rw-r--r-- 3 hbase users 42 2014-06-25 18:41 /hbase/hbase.id -rw-r--r-- 3 hbase users 7 2014-06-25 18:41 /hbase/hbase.version drwxr-xr-x - hbase users 0 2014-06-25 21:49 /hbase/oldWALs

启动和停止 Master

使用“local-master-backup.sh”最多可以启动 10 个服务器。打开HBase的home文件夹,master执行如下命令启动。

$ ./bin/local-master-backup.sh 2 4

要杀死备份主服务器,您需要其进程 ID,该 ID 将存储在名为“/tmp/hbase-USER-X-master.pid”的文件中。您可以使用以下命令终止备份主服务器。

$ cat /tmp/hbase-user-1-master.pid |xargs kill -9

启动和停止 RegionServers

您可以使用以下命令从单个系统运行多个区域服务器。

$ .bin/local-regionservers.sh start 2 3

要停止区域服务器,请使用以下命令。

$ .bin/local-regionservers.sh stop 3

启动 HBaseShell

成功安装HBase后,就可以启动HBase Shell了。下面给出了启动 HBase shell 所要遵循的步骤序列。打开终端,以超级用户身份登录。

启动 Hadoop 文件系统

浏览 Hadoop home sbin 文件夹并启动 Hadoop 文件系统,如下所示。

$cd $HADOOP_HOME/sbin $start-all.sh

启动 HBase

浏览 HBase 根目录 bin 文件夹并启动 HBase。

$cd /usr/local/HBase $./bin/start-hbase.sh

启动 HBase 主服务器

这将是相同的目录。如下图启动。

$./bin/local-master-backup.sh start 2 (number signifies specific server.)

起始区域

启动区域服务器,如下所示。

$./bin/./local-regionservers.sh start 3

启动 HBase Shell

您可以使用以下命令启动 HBase shell。

$cd bin $./hbase shell

这将为您提供 HBase Shell 提示,如下所示。

2014-12-09 14:24:27,526 INFO [main] Configuration.deprecation: hadoop.native.lib is deprecated. Instead, use io.native.lib.available HBase Shell; enter 'help<RETURN>' for list of supported commands. Type "exit<RETURN>" to leave the HBase Shell Version 0.98.8-hadoop2, r6cfc8d064754251365e070a10a82eb169956d5fe, Fri Nov 14 18:26:29 PST 2014 hbase(main):001:0>

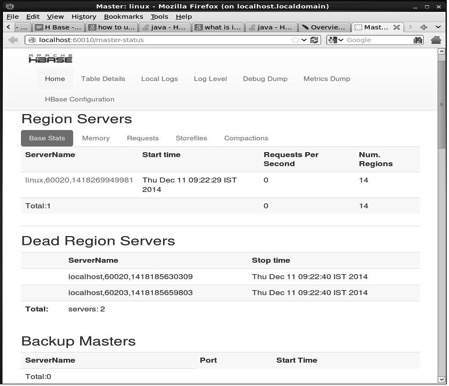

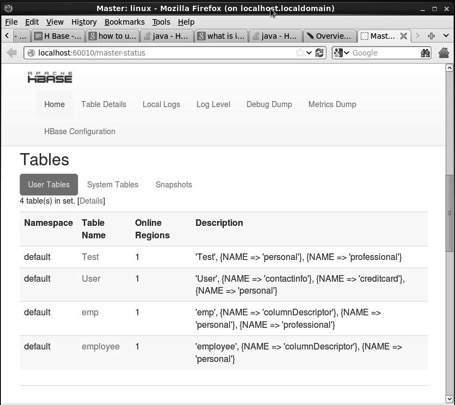

HBase 网页界面

要访问 HBase 的 Web 界面,请在浏览器中键入以下 URL。

http://localhost:60010

此界面列出了您当前运行的 Region 服务器、备份 master 和 HBase 表。

HBase 区域服务器和备份主服务器

HBase 表

设置 Java 环境

我们也可以使用 Java 库与 HBase 通信,但在使用 Java API 访问 HBase 之前,您需要为这些库设置类路径。

设置类路径

在继续编程之前,将类路径设置为.bashrc文件中的HBase 库。在任何编辑器中打开.bashrc,如下所示。

$ gedit ~/.bashrc

在其中设置 HBase 库(HBase 中的 lib 文件夹)的类路径,如下所示。

export CLASSPATH = $CLASSPATH://home/hadoop/hbase/lib/*

这是为了防止在使用 java API 访问 HBase 时出现“找不到类”异常。